首页 > 新闻中心 > 行业新闻 > 沉浸式展厅新标配:动态捕捉虚拟迎宾+多模态交互方案深度解析!行业新闻

沉浸式展厅新标配:动态捕捉虚拟迎宾+多模态交互方案深度解析!

栏目:行业新闻更新时间:2025-04-14整理发布:zbvision.cn已有 761人查阅当代展览展示行业正经历着一场静默的技术革命。当观众对传统展陈形式的期待逐渐被更高维度的感官体验所替代,展厅设计者面临的不仅是内容的创新,更是技术赋能下交互逻辑的彻底重构。在此背景下,动态捕捉虚拟迎宾系统与多模态交互解决方案的深度融合,正在重新定义”智慧展厅”的行业标准。这两大技术引擎的协同运作,不仅打破了物理空间与数字世界的次元壁,更构建起观众与展示内容之间的情感连接通道。

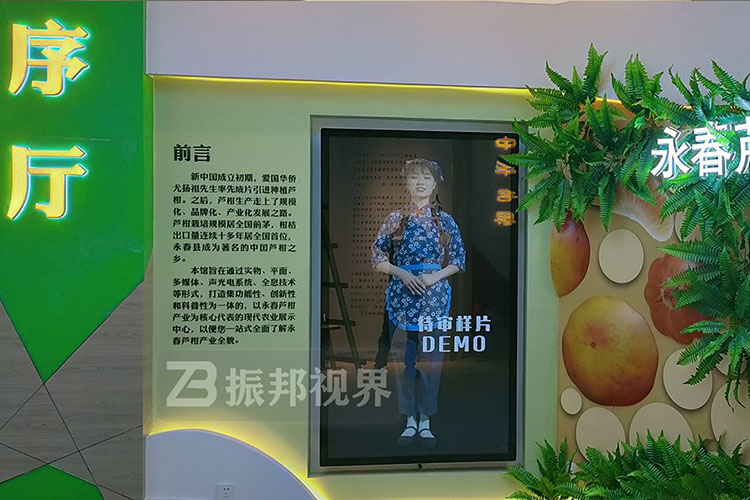

一、动态捕捉虚拟迎宾

虚拟迎宾设备早已突破早期全息投影的单一形态,通过高精度动态捕捉技术,实现与参观者的实时互动反馈。当观众步入展厅时,搭载红外传感与骨骼追踪算法的系统可精准识别人体动作轨迹,驱动虚拟形象完成眼神对视、手势回应甚至个性化对话。例如,某科技展馆通过AI驱动的虚拟讲解员,能根据观众驻留时长自动切换讲解深度,同时结合语义分析技术实时回应提问,其自然度接近真人交互水平。

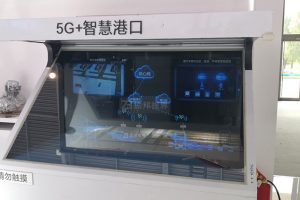

二、多模态交互方案

在虚拟迎宾构建第一印象的基础上,多模态交互技术进一步延伸了展厅的体验维度。通过整合手势识别、语音控制、体感反馈等多重交互方式,参观者无需依赖传统触控设备,仅凭自然动作即可与展项深度互动。例如,在文化主题展厅中,观众挥动手臂即可“唤醒”文物全息影像,语音指令能调取历史背景资料,而地面压力传感系统则根据行走路径触发对应的光影场景变化,形成“人走景动”的叙事节奏。

三、技术耦合效应

当动态捕捉虚拟迎宾与多模态交互方案形成技术耦合时,产生的协同效应将远超单一技术应用。虚拟形象可作为整个展厅的“智能中枢”,根据实时采集的观众情绪数据(如面部表情识别、语音语调分析),动态调整环境光效、音效甚至气味释放装置的工作参数。

四、AI赋能的数字分身

虚拟迎宾系统革新交互模式,运用AI深度架构打造可成长数字人。其融合NLP与情感算法,既复刻真人语言风格,更通过知识迭代培育鲜活数字人格。GPT-4驱动的多轮逻辑对话与神经辐射场生成的细腻微表情,让交互兼具智慧深度与情感温度,既能化身品牌虚拟大使提供沉浸式服务,更可永久保存专家智慧,开创文化传承新纪元。

如今,展厅的核心价值已从“信息陈列”转向“记忆制造”。动态捕捉虚拟迎宾与多模态交互方案的技术融合,正在重新书写“人-空间-内容”的关系定义。对于展厅运营商而言,这不仅是技术工具的升级,更是运营思维的重构,如果您也想打造一座这样的数字展厅,可随时联系我们获取详细的解决方案!

您可以通过以下方式联系我们

您可以通过以下方式联系我们

微信公众号(sz-zbvision) / QQ:2379056273

电话咨询:18617067979 / 0755-29887159

联系地址:深圳市宝安区福永大洋路90号中粮 (福安)

机器人制造产业园五栋101-103号